AI-systemen falen steeds vaker zonder alarm te slaan

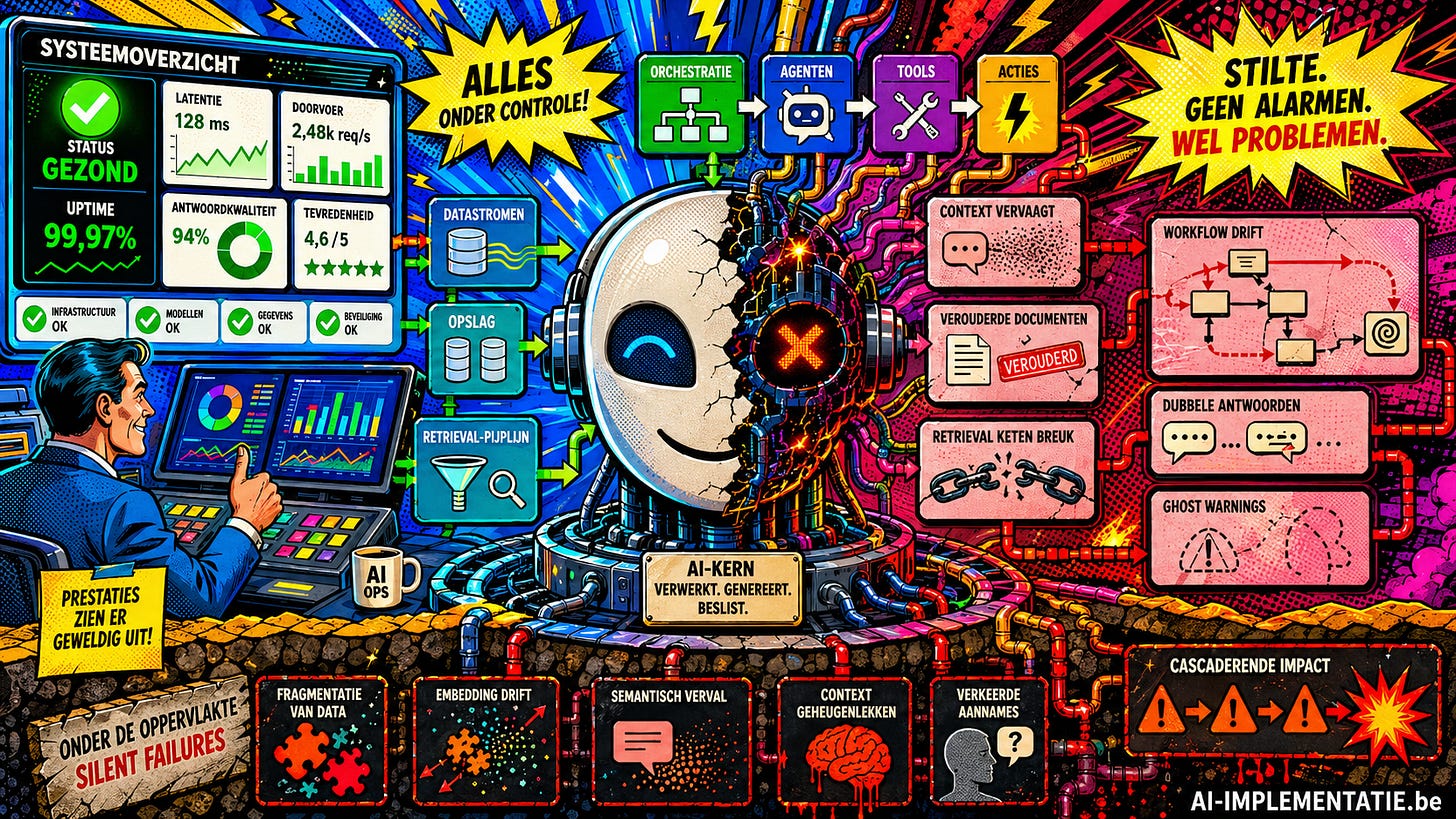

Bedrijven zetten AI in snel tempo in productie, maar hun controlesystemen zijn daar vaak nog niet op aangepast. Klassieke monitoring kijkt vooral naar uptime, snelheid en foutmeldingen. Bij moderne AI-systemen ontstaan de grootste risico’s echter elders: in verouderde context, afwijkende workflows en beslissingen die technisch correct lijken, maar inhoudelijk fout zijn.

Van technische gezondheid naar inhoudelijke betrouwbaarheid

Veel organisaties hebben de voorbije jaren geleerd hoe ze AI-modellen moeten beoordelen. Ze gebruiken benchmarks, red-teaming, nauwkeurigheidsmetingen en evaluaties van retrieval-systemen om te bepalen of een model goed genoeg presteert. Toch ontstaat het echte probleem vaak pas nadat zo’n systeem in productie draait.

Dan blijkt niet alleen het model belangrijk, maar vooral alles wat errond hangt: datastromen, contextopbouw, zoeklagen, tool calls, agent-workflows en automatische vervolgacties. Net in die combinatie ontstaan fouten die klassieke dashboards nauwelijks zien. Een AI-toepassing kan perfect online zijn, snel reageren en geen foutcodes geven, terwijl ze toch verkeerde conclusies trekt.

Het gevaar van stille fouten

Dat maakt deze nieuwe categorie storingen bijzonder verraderlijk. In traditionele IT is een defect vaak zichtbaar: een server valt uit, een API geeft een foutmelding of een applicatie wordt traag. Bij AI kan het systeem er aan de buitenkant gezond uitzien, maar ondertussen antwoorden baseren op oude documenten, onvolledige data of een verkeerd opgebouwde context.

Voor gebruikers is dat moeilijk te herkennen. De output blijft vaak vloeiend, overtuigend en professioneel geformuleerd. Daardoor ontstaat een gevaarlijke situatie: niet het systeem zelf geeft alarm, maar pas de gevolgen verderop in de organisatie maken duidelijk dat er iets misliep. Tegen dan kunnen foute beslissingen al zijn doorgeduwd naar andere teams, processen of klanten.

Vier faalpatronen keren terug

In enterprise-AI komen vooral vier faalpatronen naar voren. Het eerste is contextverval: het model redeneert met informatie die niet langer volledig of actueel is. Het tweede is orkestratiedrift: de volgorde waarin retrieval, inferentie, tools en vervolgacties samenwerken, begint onder echte productiedruk af te wijken van het testscenario.

Het derde patroon is de stille gedeeltelijke storing. Daarbij presteert één onderdeel slechter, zonder dat het onder een technische alarmdrempel zakt. Het systeem degradeert dus inhoudelijk eerder dan operationeel. Het vierde risico is de grotere automatiseringsimpact. Eén verkeerde interpretatie vroeg in een workflow kan zich verspreiden door meerdere systemen en zakelijke beslissingen.

Daarom volstaat klassieke observability niet meer. De vraag is niet alleen of een dienst werkt, maar of hij zich nog correct gedraagt. Moderne AI-systemen vragen om tracing van model-, agent- en tool-interacties. Daarmee verschuift de focus van louter infrastructuur naar het gedrag van AI-systemen zelf.

Betrouwbaarheid wordt de nieuwe AI-discipline

Ook klassieke chaos engineering moet worden uitgebreid. Het blijft nuttig om servers, netwerken en API’s onder druk te testen, maar AI-fouten ontstaan vaak subtieler. Organisaties moeten ook nagaan wat er gebeurt wanneer retrieval verouderde maar technisch geldige informatie teruggeeft, wanneer een tool call slaagt maar onvolledige data levert, of wanneer een agent bij herhaalde pogingen zijn eigen fout versterkt.

De oplossing ligt niet noodzakelijk in een volledig nieuwe infrastructuurstack. Wel moeten bedrijven hun bestaande monitoring uitbreiden met gedragsmatige telemetrie. Ze moeten kunnen zien welke context het model kreeg, welke bronnen zijn gebruikt, welke tools werden aangeroepen en wanneer het systeem onvoldoende vertrouwen heeft om verder te gaan.

Minstens even belangrijk zijn veilige stopcondities. Een AI-systeem dat zijn onderbouwing verliest, mag niet eindeloos overtuigende antwoorden blijven produceren. Het moet kunnen pauzeren, de fout markeren en overschakelen naar menselijke controle of een deterministisch alternatief.

De volgende fase van enterprise-AI zal daarom minder draaien om wie het snelst modellen uitrolt. Doorslaggevend wordt wie AI betrouwbaar kan laten functioneren onder echte bedrijfsdruk. Niet alleen het model bepaalt het succes, maar vooral de discipline van de infrastructuur eromheen.