EU AI-wet naleving: navigeren rond 14 belangrijke juridische valkuilen

De Europese AI Act (EU AI-wet) verandert fundamenteel hoe AI-systemen ontwikkeld, gelanceerd en gebruikt mogen worden binnen de Europese markt. De regelgeving wordt gefaseerd ingevoerd tussen 2024 en 2027 en legt zware verplichtingen op aan aanbieders, integratoren en gebruikers van AI-systemen. De strikte regels voor high-risk AI-systemen en de algemene transparantieverplichtingen worden juridisch afdwingbaar vanaf augustus 2026.

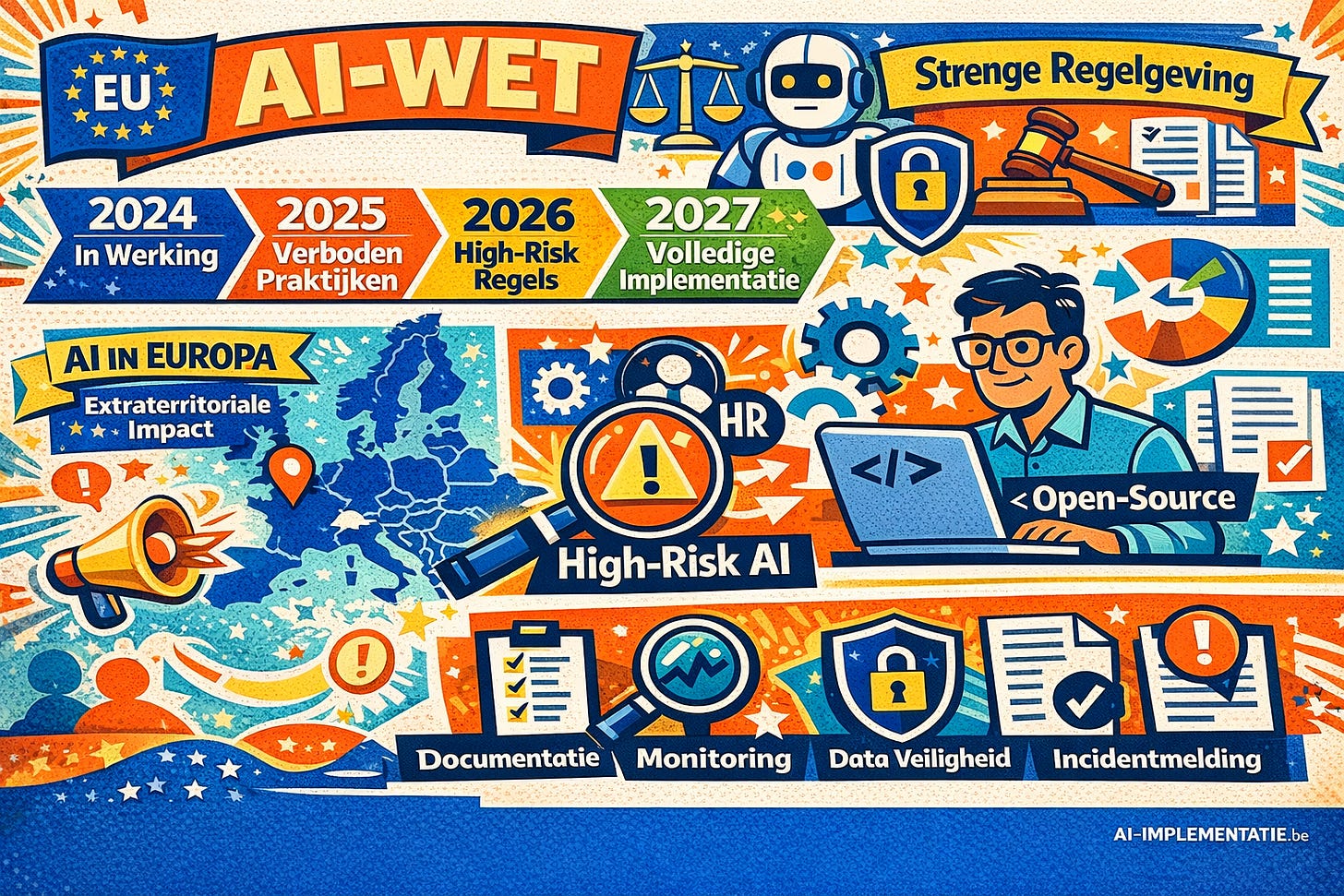

Even herhalen: De gefaseerde invoering van de regelgeving

De AI Act wordt niet in één keer volledig van kracht, maar via een meerjarige implementatie.

- 2024: De wet treedt formeel in werking.

- 2025: Verboden AI-praktijken worden effectief verboden en regels voor general-purpose AI-modellen worden ingevoerd.

- 2026: De belangrijkste verplichtingen voor high-risk AI-systemen worden afdwingbaar.

- 2027: De laatste onderdelen, waaronder regels voor AI geïntegreerd in gereguleerde producten, worden volledig toegepast.

Deze gefaseerde aanpak geeft bedrijven tijd om zich aan te passen, maar vereist ook dat compliance al in de ontwerpfase wordt ingebouwd.

Vier strategische valkuilen

1. De extraterritoriale realiteit

De locatie van het bedrijf doet er juridisch niet toe. Wat telt, is waar de output van het systeem wordt gebruikt. Zodra Europese gebruikers afhankelijk zijn van de resultaten van een AI-systeem, valt het onder de AI Act.

De mythe:

“Wij zijn een Amerikaans/Aziatisch bedrijf zonder fysiek kantoor in de EU, dus de AI Act raakt ons niet.”

De juridische realiteit:

De locatie van de provider is irrelevant. De locatie van de output (beslissingen, scores, aanbevelingen) is bepalend. Indien de resultaten van uw AI-agent invloed hebben op personen in de EU, bent u gebonden aan de wet.

2. “Classification creep”

Veel organisaties onderschatten hoe snel een systeem juridisch als high-risk kan worden geclassificeerd. Een intern analyse- of research-systeem kan bijvoorbeeld high-risk worden zodra het wordt gebruikt voor HR-beslissingen, kredietbeoordelingen of onderwijsbeoordelingen.

De mythe:

“Wij bouwen slechts een interne workflow-optimizer, geen high-risk systeem.”

De juridische realiteit:

De wet kijkt naar de juridische functie (Annex III) en de feitelijke context, niet naar uw marketinglabels. Een onschuldige “interne research-agent” die plotseling toegang krijgt tot HR-data en aanbevelingen doet voor promoties, transformeert juridisch direct naar een high-risk systeem.

3. Verschuivende aansprakelijkheid

Wanneer een klant een systeem ingrijpend wijzigt, bijvoorbeeld door nieuwe databronnen te koppelen of het gebruiksdoel te veranderen, kan die klant juridisch de rol van provider overnemen. Daarmee verschuift ook de volledige compliance-verantwoordelijkheid.

De mythe:

“De rollen van ‘provider’ en ‘deployer’ liggen contractueel vast.”

De juridische realiteit:

Bij een substantial modification, zoals het koppelen van nieuwe databronnen of het wijzigen van het beoogde gebruiksdoel wordt de deployer (de klant) wettelijk de provider. Dit brengt de volledige last van conformiteitsbeoordelingen en technische documentatie met zich mee.

4. De open-source misvatting

Open-source AI-modellen vormen geen uitzondering op de regelgeving. Zodra een model wordt ingezet voor high-risk toepassingen, gelden exact dezelfde verplichtingen als voor commerciële modellen.

De mythe:

“Open-source modellen vallen onder de uitzonderingen van de AI Act.”

De juridische realiteit:

Open-source is een licentiemodel, geen regulatoire vrijbrief. Hoewel er beperkte uitzonderingen zijn voor de modellen zelf, vervallen deze volledig zodra het model wordt ingezet voor high-risk taken. Een AI-agent op basis van Llama-3 die kredietrisico’s inschat, moet aan exact dezelfde strenge eisen voldoen als een propriëtair model.

Tien operationele valkuilen

Naast strategische fouten ontstaan compliance-problemen vaak in de dagelijkse werking van AI-systemen.

5. Menselijk toezicht moet effectief zijn.

Een simpele disclaimer volstaat niet; operators moeten daadwerkelijk kunnen ingrijpen en beslissingen kunnen overrulen.

6. Logging en reproduceerbaarheid zijn essentieel.

Voor high-risk systemen moeten organisaties kunnen aantonen welke input, modelversie en parameters tot een bepaalde beslissing hebben geleid:

- Inputdata en systeemcontext.

- Modelversie en gebruikte parameters.

- Confidence scores en de overwogen alternatieven.

- Expliciete menselijke interventies of overrides.

7. Documentatie moet vanaf het ontwerp aanwezig zijn.

Zonder technisch dossier met architectuur, risicoanalyses en validatieprocedures kan een systeem niet legaal op de markt worden gebracht.

8. Data governance wordt streng gecontroleerd.

Bedrijven moeten kunnen aantonen waar data vandaan komt, hoe representatief die is en welke maatregelen zijn genomen om bias te voorkomen.

9. Continue monitoring na lancering is vereist.

Compliance stopt niet bij deployment; bedrijven moeten modelgedrag blijven evalueren en nieuwe risico’s detecteren.

10. Mechanisme voor incidentmeldingen verplicht

Bij ernstige problemen, bijvoorbeeld discriminatoire output of veiligheidsrisico’s, geldt een verplicht incident-meldingsmechanisme richting toezichthouders.

Verder legt de AI Act een sterke nadruk op transparantie.

Gebruikers moeten weten wanneer zij met AI interageren en hoe beslissingen tot stand komen. Ook binnen de AI-supply chainblijft elke partij verantwoordelijk voor zijn eigen rol. Vertrouwen op de compliance van een modelprovider ontslaat integratoren of deployers niet van hun verplichtingen.

Ten slotte geldt de regelgeving ongeacht de grootte van een bedrijf. Een startup met drie medewerkers moet voor een high-risk systeem dezelfde technische robuustheid aantonen als een multinational.

Sancties en strategische implicaties

De EU AI Act is een bindend juridisch kader met zware sancties. Bedrijven riskeren boetes tot 15 miljoen euro of 3% van de wereldwijde jaaromzet bij overtredingen. Voor het verstrekken van onjuiste of misleidende informatie kunnen boetes oplopen tot 7,5 miljoen euro of 1% van de omzet.

De belangrijkste les voor bedrijven is duidelijk: classificatie wordt bepaald door feitelijk gebruik, aansprakelijkheid kan verschuiven bij wijzigingen, en open-source biedt geen juridische bescherming.

Voor organisaties die AI ontwikkelen of implementeren is een grondige audit van hun AI-portfolio, documentatie en contracten een noodzakelijke stap om veilig en duurzaam te kunnen opereren op de Europese markt.