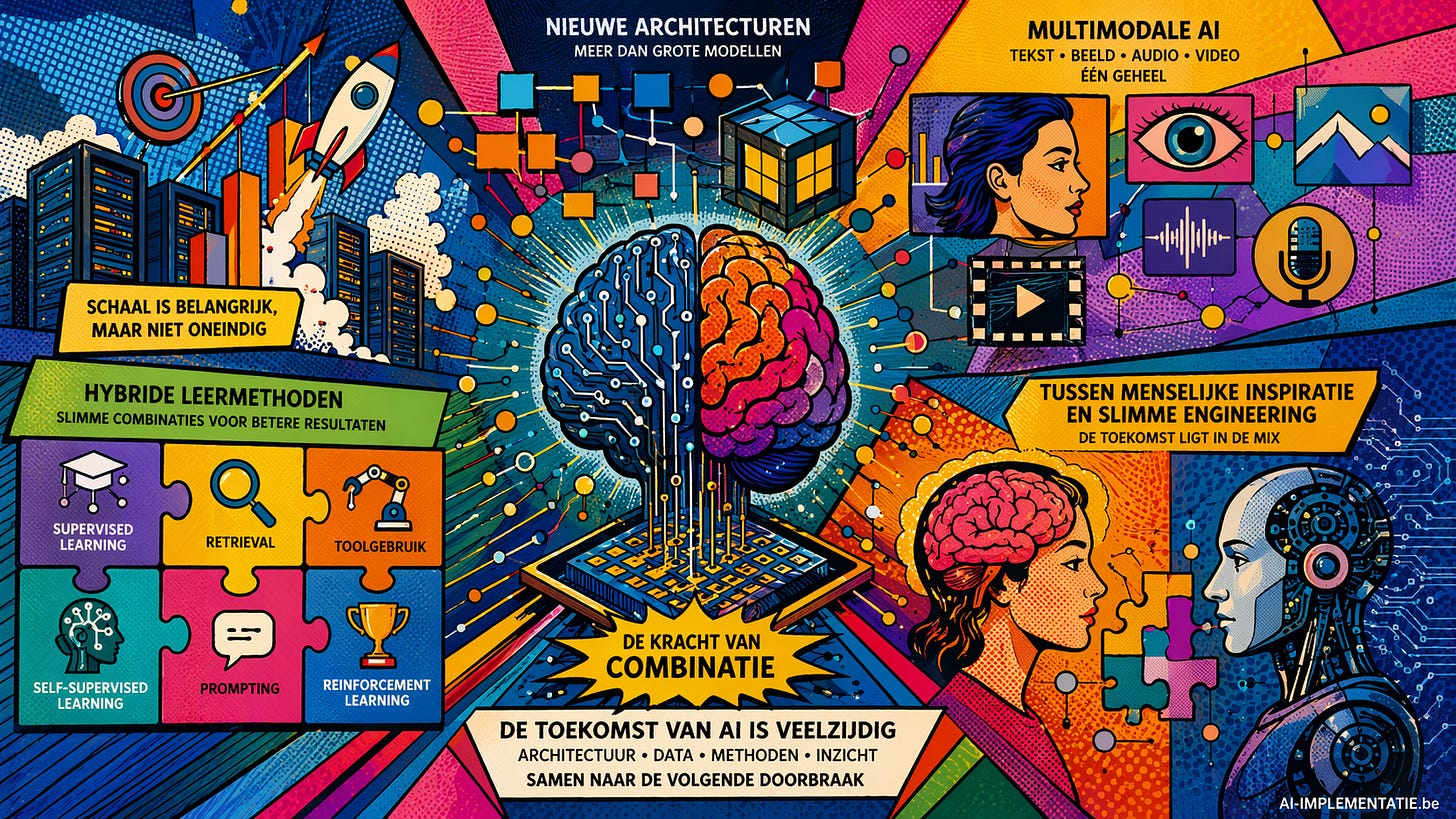

Waarom de volgende AI-doorbraak wellicht niet alleen uit opschalen komt

Grotere modellen en meer rekenkracht leveren nog altijd vooruitgang op, maar steeds meer signalen wijzen erop dat pure schaalvergroting niet volstaat voor de volgende grote sprong. De aandacht verschuift daarom naar nieuwe architecturen, multimodale systemen en slimmere combinaties van leermethoden. De toekomst van AI zal vermoedelijk minder draaien om één dominante aanpak, en meer om de wisselwerking tussen verschillende technieken.

Schaal blijft belangrijk, maar niet onbeperkt

De voorbije jaren leek het succesrecept in AI bijna vanzelfsprekend: meer data, meer compute en grotere modellen. Die strategie heeft zonder twijfel indrukwekkende resultaten opgeleverd. Toch groeit binnen het vakgebied het besef dat die aanpak op termijn minder spectaculaire winsten kan opleveren dan in de beginfase van de huidige AI-golf.

Dat betekent niet dat de vooruitgang stilvalt. Wel wordt duidelijk dat schaalvergroting alleen waarschijnlijk niet genoeg is om opnieuw een fundamentele sprong te maken. Naarmate modellen groter worden, stijgen ook de kosten, de complexiteit en de vraag of extra schaal nog in verhouding staat tot de winst. De discussie verschuift daardoor van “hoe maken we modellen groter?” naar “wat ontbreekt er nog in de huidige aanpak?”

De volgende sprong kan uit nieuwe architecturen komen

In de geschiedenis van AI kwamen de grootste doorbraken zelden voort uit puur opschalen. Vaak was een nieuwe architectuur de echte motor van verandering. De transformer is daar het bekendste voorbeeld van: die legde de basis voor de huidige generatie grote taalmodellen en generatieve AI.

Vandaag zoeken onderzoekers opnieuw naar zulke structurele vernieuwing. Daarbij gaat het onder meer om systemen met expliciete geheugenstructuren, nieuwe vormen van routing en alternatieve manieren om redeneren, toolgebruik en contextbeheer te organiseren buiten het klassieke next-token-model. Zulke experimenten tonen aan dat de sector steeds nadrukkelijker verkent hoe AI-systemen anders opgebouwd kunnen worden, in plaats van alleen groter gemaakt.

Multimodale AI en hybride leermethoden winnen terrein

Een andere duidelijke evolutie is de opkomst van multimodale AI. Moderne systemen verwerken niet langer alleen tekst, maar combineren steeds vaker ook beeld, audio en video. Dat maakt AI niet alleen veelzijdiger, maar kan ook de prestaties verbeteren: kennis uit de ene modaliteit versterkt vaak het begrip in een andere.

Daarnaast verschuift ook de manier waarop modellen worden getraind. Waar de eerste generatie LLM’s vooral draaide op self-supervised learning en later instructietuning, groeit nu het belang van hybride aanpakken. Reinforcement learning, retrieval, prompting, toolgebruik en klassieke supervised learning worden steeds vaker in één systeem samengebracht. De kans is groot dat toekomstige AI niet zal steunen op één enkele leermethode, maar op slimme combinaties die aangepast worden aan de taak.

Tussen menselijke inspiratie en pure engineering

Binnen AI-onderzoek loopt tegelijk een bredere discussie over de richting van het veld. Sommige onderzoekers kijken nadrukkelijk naar het menselijke brein en proberen principes als aandacht, geheugen, planning en langetermijnleren te vertalen naar nieuwe AI-systemen. Andere teams kiezen voor een meer pragmatische benadering en bouwen oplossingen die niet biologisch geïnspireerd hoeven te zijn, zolang ze efficiënt en schaalbaar zijn.

Waarschijnlijk ligt de toekomst ergens tussen beide. De volgende generatie AI zal vermoedelijk elementen overnemen uit menselijke cognitie, maar die combineren met structuren die specifiek ontworpen zijn voor machines. Net daarin schuilt wellicht de grootste kans op vooruitgang.

Wat vandaag vooral opvalt, is de snelheid waarmee het vakgebied verandert. Nieuwe technieken, combinaties en onderzoekslijnen volgen elkaar in hoog tempo op. Wie AI wil begrijpen, kijkt daarom best niet alleen naar de hype van het moment, maar naar de grotere beweging erachter.