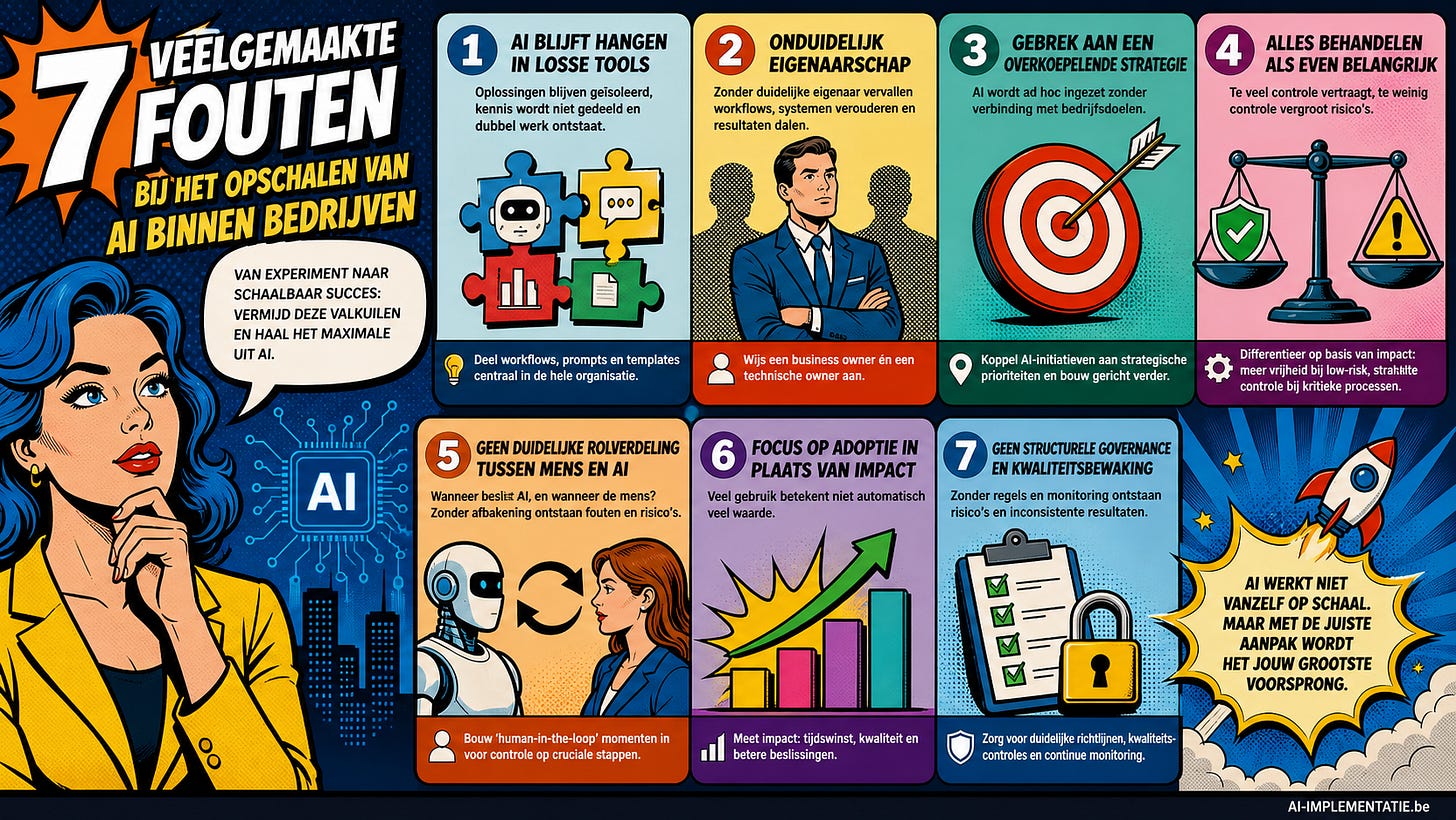

Zeven veelgemaakte fouten bij het opschalen van AI binnen bedrijven

AI biedt bedrijven enorme kansen, maar de stap van experiment naar schaal blijkt vaak moeilijker dan verwacht. Niet de technologie zelf vormt het probleem, maar de manier waarop organisaties AI structureren, beheren en meten. Versnippering, gebrek aan strategie en onduidelijke verantwoordelijkheden zorgen ervoor dat veel initiatieven hun potentieel niet waarmaken.

Waarom AI-projecten vastlopen bij schaalvergroting

Binnen veel organisaties begon AI als een experimentele speeltuin: teams testten tools, automatiseerden kleine taken en boekten snelle resultaten. Maar zodra die initiatieven moeten uitgroeien tot bedrijfsbrede oplossingen, komen structurele zwaktes naar boven. Zonder duidelijke aanpak verzanden projecten al snel in inefficiëntie.

1. AI blijft hangen in losse tools

Een van de grootste valkuilen is fragmentatie. Teams bouwen eigen AI-workflows, maar die blijven geïsoleerd. Kennis wordt niet gedeeld en oplossingen worden niet hergebruikt.

Succesvolle organisaties doorbreken dit door centrale systemen op te zetten waarin workflows, prompts en automatiseringen gedeeld worden. Zo groeit AI uit tot een collectieve kracht in plaats van individuele experimenten.

2. Onduidelijk eigenaarschap

Veel AI-oplossingen starten sterk, maar verliezen snel hun waarde doordat niemand verantwoordelijk is voor onderhoud. Modellen verouderen, workflows breken en prestaties dalen.

Duidelijke eigenaarschap is cruciaal: zowel een business owner als een technische verantwoordelijke zorgen ervoor dat systemen blijven presteren en evolueren.

3. Gebrek aan een overkoepelende strategie

AI wordt vaak ad hoc ingezet, zonder duidelijke langetermijnvisie. Teams experimenteren los van elkaar, zonder afstemming op bedrijfsdoelen.

Bedrijven die wél slagen, koppelen AI-initiatieven expliciet aan strategische prioriteiten. Ze bepalen vooraf waar AI de meeste impact kan maken en bouwen van daaruit gericht verder.

4. Alles behandelen als even belangrijk

Niet elke AI-toepassing vereist dezelfde aanpak. Toch hanteren veel organisaties één uniforme strategie, wat leidt tot overmatige controle of net te weinig toezicht.

Een slimme aanpak differentieert: low-risk toepassingen krijgen ruimte om snel te evolueren, terwijl kritische processen streng bewaakt worden.

5. Geen duidelijke rolverdeling tussen mens en AI

Wanneer AI zonder duidelijke grenzen wordt ingezet, ontstaan risico’s. Systemen nemen beslissingen zonder menselijke controle of genereren output die ongefilterd gebruikt wordt.

Daarom is het essentieel om bewust te bepalen waar menselijke tussenkomst nodig blijft. “Human-in-the-loop” is geen rem, maar een noodzakelijke veiligheidslaag.

6. Focus op adoptie in plaats van impact

Veel bedrijven meten succes op basis van gebruik: hoeveel medewerkers werken met AI-tools? Maar dat zegt weinig over de werkelijke waarde.

De focus moet liggen op impact: tijdswinst, kwaliteitsverbetering en betere besluitvorming. Alleen zo wordt AI een strategisch instrument.

7. Geen structurele governance en kwaliteitsbewaking

AI zonder duidelijke regels leidt tot inconsistente resultaten en risico’s rond data en betrouwbaarheid. Toch ontbreekt het in veel organisaties aan duidelijke richtlijnen.

Sterke AI-strategieën bevatten duidelijke policies, kwaliteitscontroles en continue monitoring. AI vereist blijvend beheer en optimalisatie, geen eenmalige implementatie.

Van experiment naar schaalbare AI-strategie

De kern van het probleem is duidelijk: AI opschalen vraagt meer dan technologie alleen. Het vereist structuur, samenwerking en duidelijke keuzes.

Organisaties die AI succesvol integreren, behandelen het niet als een losse tool, maar als een fundamenteel onderdeel van hun werking. Door strategie, eigenaarschap en governance te combineren, transformeren ze losse experimenten in duurzame impact.